Доброго времени суток, уважаемые читатели. Хотелось бы вам, чтобы в поисковой системе оказалась ваша личная информация? Есть ли на вашем сайте или будут странички, которые не должен видеть поисковый робот? Сегодня вы узнаете, как создать правильный robots txt для wordpress и защититься от нежелательного проникновения.

Общая информация о файле

Допустим у вас есть коробка, в которой лежат ваши книги, список паролей и паспорт. Согласитесь, некоторые из этих вещей не хочется никому показывать, другие же можно доверить избранным. Файл robots предназначен для поисковых роботов Яндекса и Гугл, он показывает куда им лезть можно, а куда нет.

Например, ваш клиент хочет, чтобы цену на услуги его фирмы видели только те люди, которые уже прочитали несколько статей на портале, а поисковая система хоть убей на вопрос «цена торта в фирме N» выдает нежелательную страничку. Правильно составленный robots.txt позволит избежать ненужной индексации страниц.

По сути, роботы поисковых систем могут залезть куда угодно и скачать что угодно, но если вы ставите запрет, то они не станут пытаться взломать конфиденциальную информацию и пропустят все мимо ушей.

Еще один пример, клиент хоть убей хочет определенную страницу, а вы понимаете, что она негативно повлияет на позиции в поисковой выдаче. Он старался, сам писал текст, а там столько ошибок, обилие ненужных слов, что просто ужас. Согласитесь, доказывать, что он идиот нельзя. Ок, не проблема – выложим, но пусть его работа хотя бы будет видна минимуму и уж точно не влияет на вашу работу по продвижению.

Итак, о важности вы поняли. Если robots-а нет, то поисковик читает всю информацию, рассказывает ее другим, еще и понижает позицию в выдаче поисковых систем нередко за то, что вы даже не делали. Например, вам оставили кучу мусорных комментариев, поисковик это заметил, а вы нет. Ладно, не будет о грустном.

Основные понятия и базовые элементы

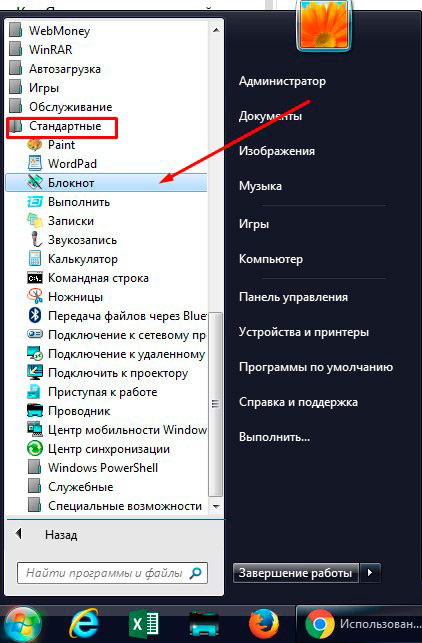

Откройте блокнот в меню «Пуск» (левый нижний угол).

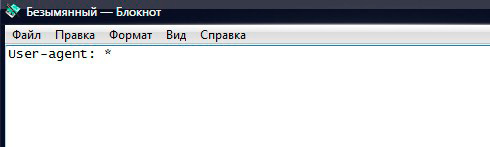

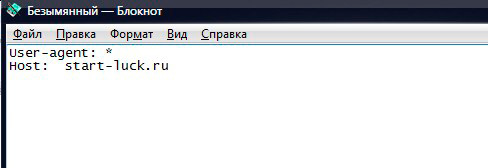

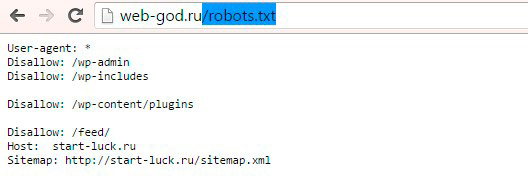

Начинаем с директивы User-agent. После нее вы как бы называете имена тех, для кого создается данный robots.txt. Напишете — User-agent: . Чтобы документ затрагивал всех поисковых роботов, необходимо поставить звездочку. Как на скриншоте ниже.

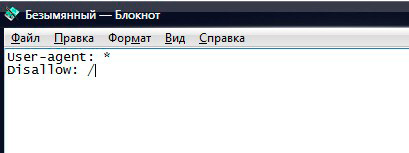

Директива Disallow означает запрет. Ставите напротив нее «/» и ваш сайт вообще не будет индексироваться и появляться в поисковой выдаче. Конечно же, использовать его так не стоит, иначе читателей вам не видать!

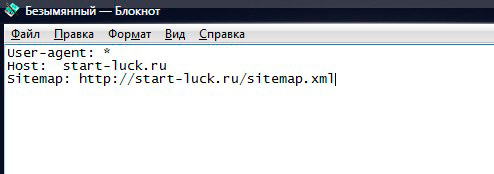

Предназначение директивы Host особенно актуально если у вашего сайта есть несколько зеркал. Если вы не знаете зачем они нужны, то подписывайтесь на рассылку моего блога и узнаете первым, когда статья на эту тему появится на сайте. А пока просто запомните, host – это название вашего сайта без http.

Пример можно посмотреть на рисунке ниже. Естественно, домен нужно будет заменить на тот, для которого готовите файл.

Далее, карта сайта. Sitemap. Если вы не знаете, что это такое – ждите будущих публикаций, а пока просто впишите в файл Sitemap: домен_сайта_с_http/sitemap.xml. Как на рисунке. За исключением домена. Его также нужно заменить на свой.

После того как вы закончите закрывать странички, которые не должны попадаться на глаза другим людям и машинам, документ нужно сохранить как robots.txt и поместить его в корневую папку на хостинге. К этому мы еще вернемся, и я пошагово объясню как это сделать, а пока давайте немного подробнее.

Углубляемся в вордпресс

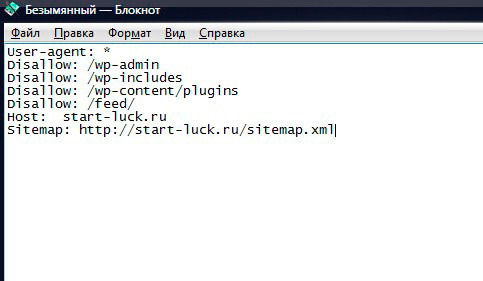

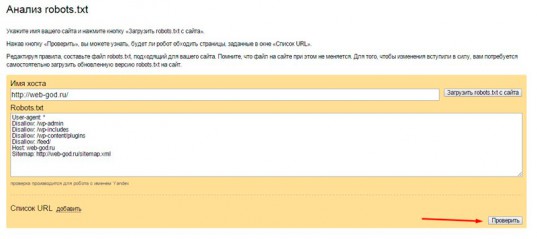

Естественно, закрываться может все что угодно и каждый создает свой документ, но что используется чаще? Папка с административными файлами, служебными библиотеками и плагинами. Адреса, если вы работаете на вордпрессе, будут такие же, как и у меня, но на всякий случай сверьтесь. Мало ли что.

Вы также можете закрыть темы, кэш, комментарии. Подумайте самостоятельно, что может негативно повлиять на место в вашей выдаче. Здесь ничего нового. Просто ставите ссылки напротив dissalow.

Один из важных элементов вписать различные url-адреса, которые могут привести к образованию дублей. Подробнее о них будем говорить в будущих публикациях, а пока давайте сохраним и закачаем файл на хостинг, а также научимся редактировать его в процессе работы.

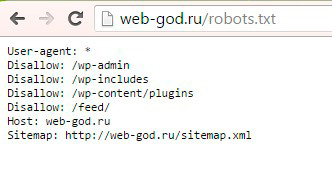

Как сохранить файл

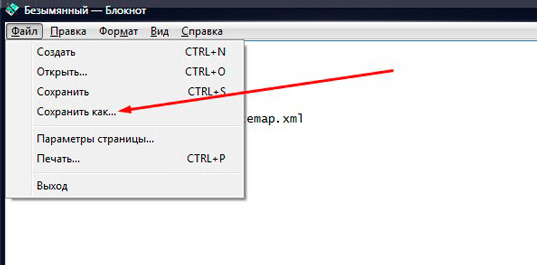

Думаю, здесь не будет проблем. «Сохранить как…».

Файл обязательно должен называться robots.txt и никак иначе. В противном случае поисковые системы не обратят на него никакого внимания.

Не буду лишний раз рассказывать, что сам пользуюсь хостингом Таймвеб (https://timeweb.ru), что он идеально прост для новичка и отвечает требованиям более продвинутых программистов, а также о бесплатном тестовом периоде, который длится 10 дней, в течение которого вы можете проверить свои возможности. Мне, по сути, совершенно все равно. Но если вы хотите научиться всему благодаря моему блогу, то и в будущем я буду работать с этим хостингом. Будет намного удобнее пользоваться одними и теми же ресурсами.

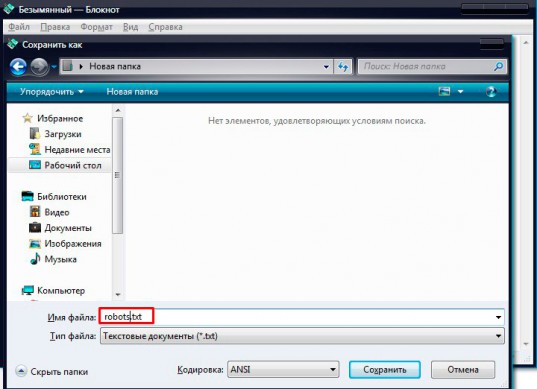

Как залить роботса на хостинг и упростить работу на будущее

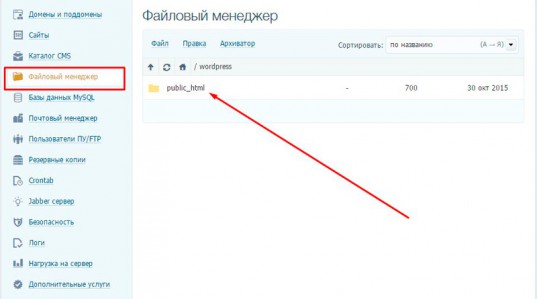

Заходите на хостинг Timeweb, положительных отзывов о работе которого в моем блоге предостаточно. Находите «Файловый менеджер», там лежат папки с вашим сайтом.

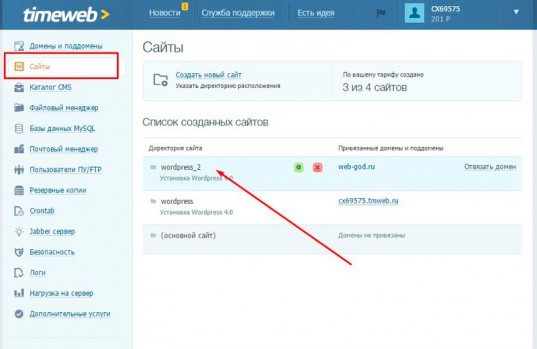

Если у вас такая же неразбериха как и у меня, отправляйтесь в раздел «Сайты» и посмотрите какая папка к какому домену относится.

Теперь возвращаемся обратно и тыкаемся в нужную нам папку, с названием теперь понятно. Здесь видим public_html. Кликаем два раза.

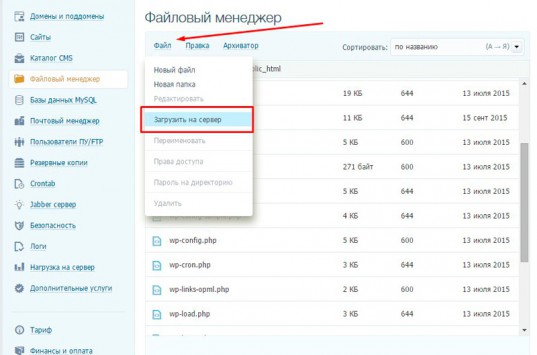

Мы на правильном пути. Это и есть корневая папка или корень сайта. Щелкаем по кнопке «Файл» — «Загрузить на сервер».

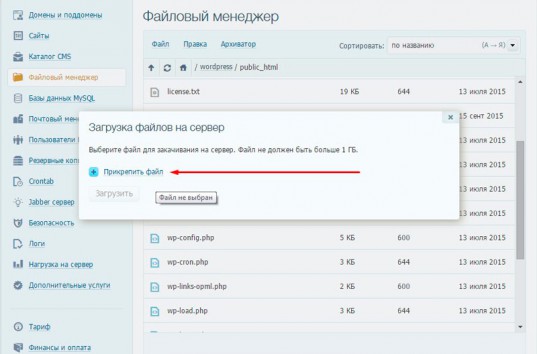

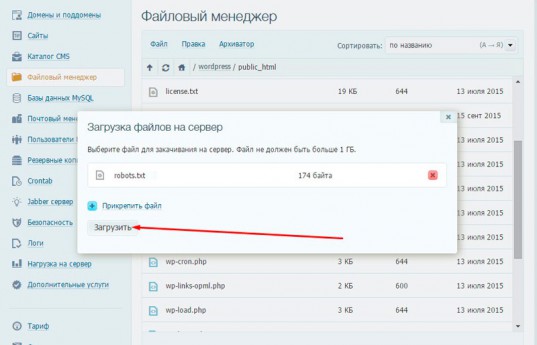

Теперь нужно прикрепить файл.

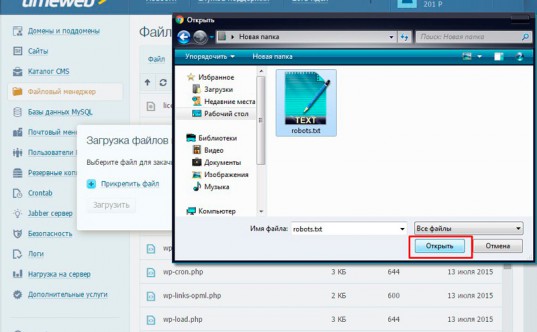

Находим его у себя на компьютере. Открываем.

Загружаем.

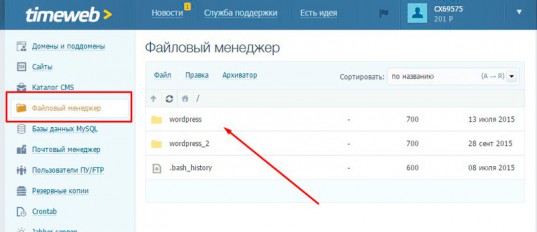

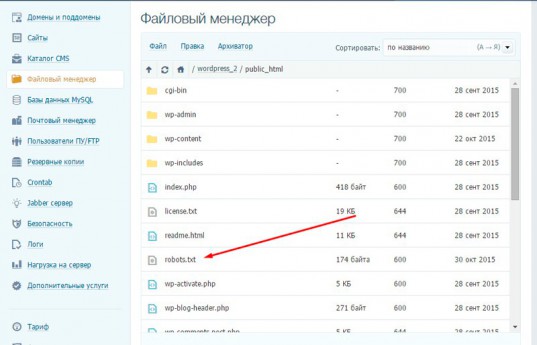

Теперь, если в поисковой строчку к вашему домену прибавите «/robots.txt», то увидите вот такую страничку.

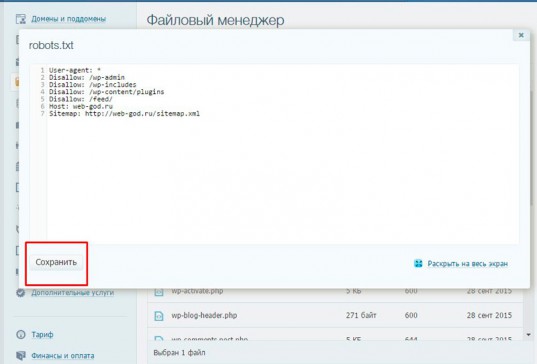

Как вы можете увидеть урл хоста и карты сайта в моем примере не соответствует тому, к которому прикреплен документ. Исправить ситуацию не проблематично. Возвращаемся в корневую папку, открываем public_html, находим роботс, два раза щелкаем по нему и автоматически находим ответ на вопрос как внести изменения прямо на хостинге.

Работать можно прямо тут. Исправляем ошибки и нажимаем «Сохранить».

Вуа-ля. Теперь все грамотно.

Как проверить все ли верно

При помощи Яндекса вы можете проанализировать свою работу, проверить будут ли с ним считаться поисковые системы. Проходим по этой ссылке https://webmaster.yandex.ru/robots.xml

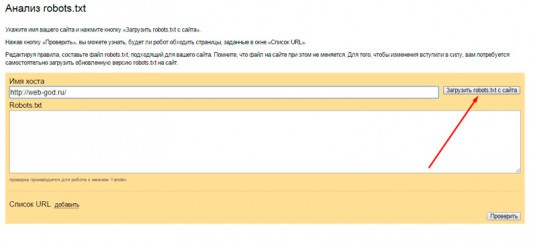

Вводим наш домен и загружаем файл.

Теперь нажимаем «Проверить». Убеждаемся, что Яндексу нравится наша работа.

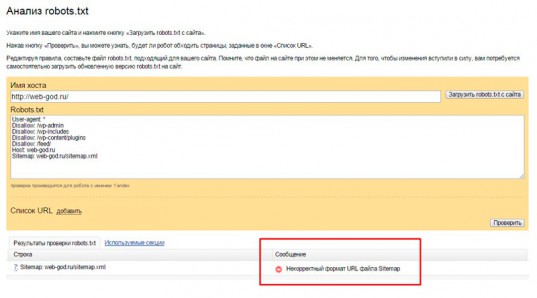

Если хотите проверить корректность, можете убрать из директивы Sitemap «html».

Готово. Теперь вы знаете как предохраниться от нежелательных глаз роботов. На этом все. Я с вами прощаюсь и не забывайте, вас ждет еще много интересного! Подписывайтесь на рассылку и создавайте правильные вещи.

Желаю удачи и до новых встреч.

Как вывести хлебные крошки на сайте Wordpress при помощи плагина

Как вывести хлебные крошки на сайте Wordpress при помощи плагина Программы, плагины и онлайн сервисы для создания Sitemap.xml

Программы, плагины и онлайн сервисы для создания Sitemap.xml Как быстро и безопасно ускорить индексирование страниц в Яндексе

Как быстро и безопасно ускорить индексирование страниц в Яндексе